«Чудеса нейросетей». Что такое «дипфейк» и как его распознать

Опубликовано

Выражение «доверяй, но проверяй» в наших реалиях обрело особое значение. Сейчас, помимо фейковых новостей в информационных воинах, в нашей жизни появилось новое, но уже нашумевшее понятие – дипфейк.

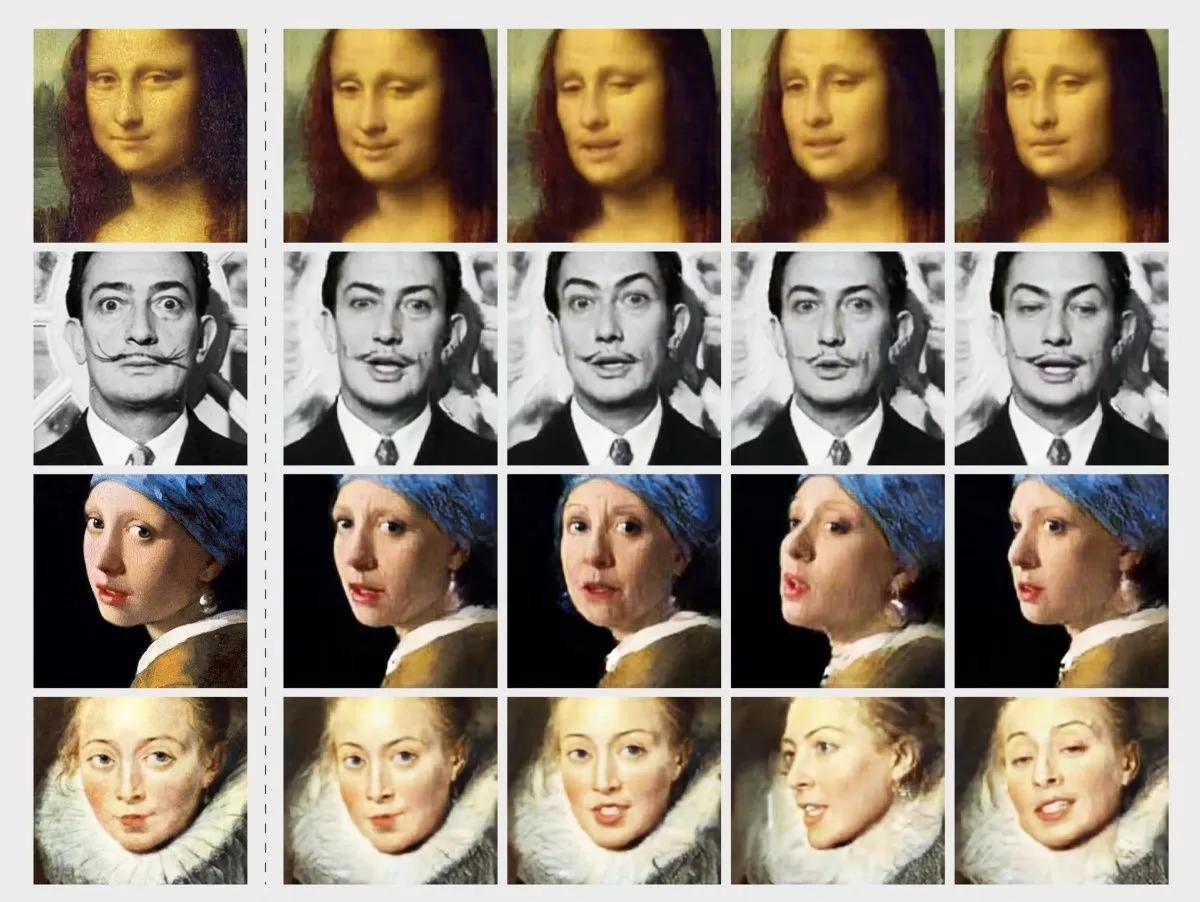

В 2017 году в сеть просочился фильм для взрослых, в котором фигурировала известная американская актриса Галь Гадот, однако, как позже выяснилось, она никогда не принимала участия в таком фильме. Оказалось, что лицо актрисы совместили с телом абсолютно другой девушки, используя технологию дипфейков, а автором этого видео является пользователь Reddit под ником deepfake. Собственно, тогда общественность и узнала о таком явлении.

Конечно, дипфейки изначально воспринимались негативно, ведь они в основном использовались в пикантном контенте или же для создания общественных резонансов и политических скандалов. Так, например, в 2019 году в сети было опубликовано дипфейк-видео с «подвыпившим» спикером палаты представителей конгресса США Нэнси Пелоси.

Также дипфейки активно используются мошенниками. Был случай, когда в интернете появилось дипфейк-видео с известным российским рэпером Моргенштерном. Он якобы предлагал получить денежные выплаты, однако у всех, кто вводил свои банковские данные, позже начали пропадать деньги.

Конечно, технологии не могут быть плохими или хорошими – все зависит от того, как человек их используют. Например, Дэвид Бэкхем снялся в социальном ролике об опасности малярии, в котором заговорил на 9-ти разных языках. В этом ролике использовалась технология дипфейков: носители языков произносили текст, ну, а программа искусственного интеллекта подстроила его под тембр голоса футболиста.

.jpg)

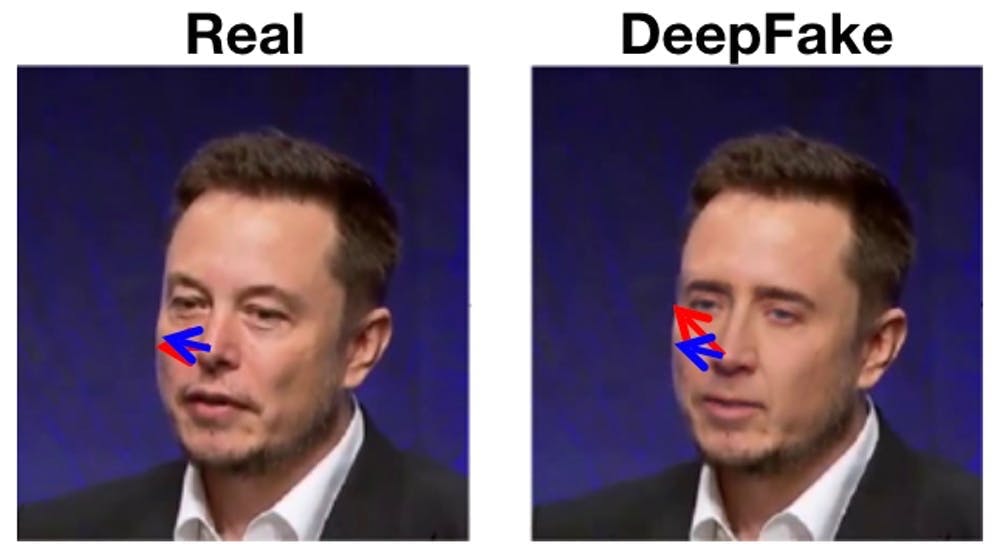

• Обращайте внимание на излишнюю пикселизацию, дефекты и смазанное изображение, а также дублирование элементов.

• Если мимика неестественна, особенно при моргании, движении бровей и губ, то велика вероятность, что перед вами дипфейк.

• Стоит отметить и низкое качество видео, за которым нередко пытаются скрыть некорректную работу нейросетей.

• Присмотритесь на отличия в телосложении, прическе и голосе. Создатели дипфейков часто подбирает похожих по типажу актеров, а голос может быть скорректирован с помощью технологии дипфейк, например, в программах RealTimeVoiceCLoning, Resemble и Descript.

• В наиболее распространённых дипфейках заменяется только лицо, поэтому можно заметить границу изменения лица, различие в тенях, освещенности и оттенке кожи.

Самые интересные новости в telegram-канале Halva.tj

Больше интересного в группе Halva.tj на Facebook и на странице в Instagram